1-训练一套算法

主要在于数据和模型,only scale matters!。

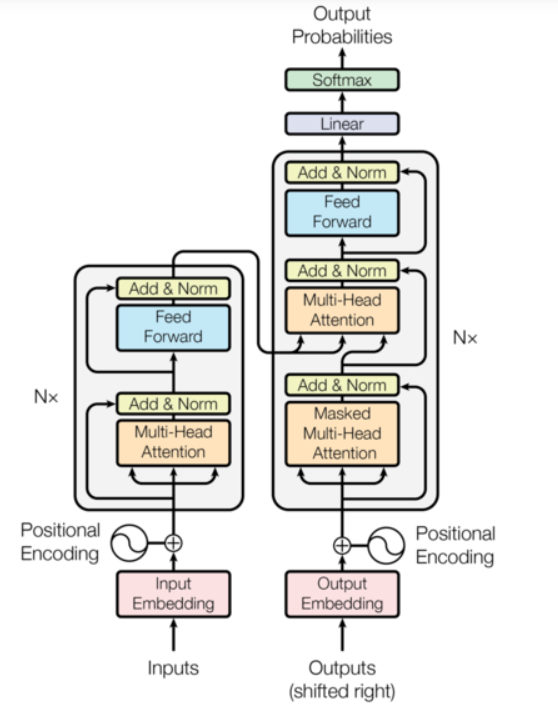

经典的transformer架构如下图所示,分为编码器和解码器。构建模型的过程中,先构建通用的模块,如位置编码、多头自注意力、前馈神经网络层等,然后组建编码器和解码器,最后统一到一个模型中。

尽管面临泡沫质疑,资金仍在涌向大模型。科技巨头正在为通往通用人工智能的基础设施添砖加瓦。英伟达创造算力硬件,微软、亚马逊与谷歌分发这些算力,四家公司的总市值从ChatGPT刚推出时的4万亿美元,迈向10万亿美元,成为推动美国股市上涨的主导力量。在风险投资市场,几乎只有人工智能相关初创企业才能享受到估值的提升。

在估值不断上升中,人们开始担心,这一切是否能够持续。红杉资本年度演讲递出了“刀子”:去年企业投入500亿美元买的GPU,最终应用收回来30亿美元。

暂时无法盈利的创新,甚至最终无法盈利的创新,算是一次泡沫吗?在创新最终盈利之前,市场必然需要迎来一次泡沫吗?这一切取决于我们是否把生成式AI的突破所代表的通用人工智能(AGI),看成是一次真正的技术革命。

批量归一化(BatchNorm: BN)在搭建深度网络模型中是必不可少的一层,刚开始学习的时候还对其有所了解,后面渐渐的只会使用,已经忘记BN的真正作用和起作用的原理了。现在查找资料进行一个简单的梳理。

每到年底,公司内部都会组织一个项目评审会议用来决定来年将要进行立项研发的产品项目。今年共有5个项目参与评审,我有其中一个。去年我也有一个项目参加评审,但由于我提前过年回家了,由领导代为评了,所以今年也是我第一次参加公司的评审会议。

PPT的写作技能,毋庸置疑是工作上很有用的技能。工作再努力,也要让人看到才可以。正所谓高调做事,低调做人。

闲话少说,我觉得以下几点PPT写作技巧以后可能会用到: